Internacionales

Regulación digital

Australia exige a Roblox y Minecraft reforzar la seguridad infantil

22/04/2026 | El organismo de control pidió informar protocolos, personal y medidas ante grooming, abuso y extremismo.

El gobierno de Australia dio un paso más en su ofensiva para proteger a menores en internet. A través de su regulador de seguridad digital, exigió a plataformas de videojuegos online que expliquen en detalle cómo previenen delitos como el acoso, la explotación sexual y la radicalización.

La medida apunta directamente a servicios masivos como Roblox, Minecraft, Fortnite y Steam, que deberán responder a requerimientos legales sobre sus sistemas de moderación, personal dedicado a seguridad y mecanismos para detectar conductas peligrosas.

La funcionaria a cargo del organismo advirtió que estos entornos ya no son solo juegos, sino espacios sociales donde millones de chicos interactúan diariamente, muchas veces con desconocidos. Según datos oficiales, nueve de cada diez jóvenes australianos entre 8 y 17 años participan en videojuegos online, lo que los convierte en un objetivo atractivo para adultos con intenciones delictivas.

Cómo operan los riesgos dentro de los juegos

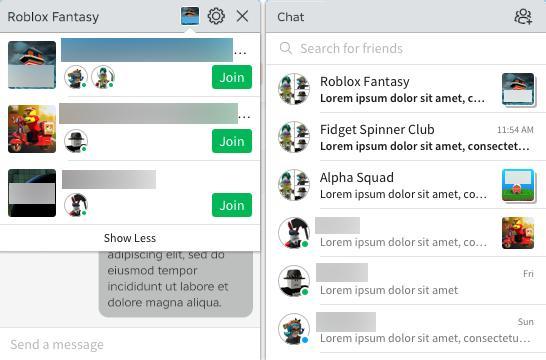

Las autoridades explicaron que el contacto inicial entre agresores y menores suele producirse dentro de los propios juegos, a través de chats o funciones sociales. Luego, en muchos casos, los delincuentes intentan trasladar la conversación a servicios de mensajería privada o cifrada, donde el control es más difícil.

Este proceso puede derivar en situaciones graves como grooming, extorsión sexual o incluso la difusión de ideologías extremistas. En ese sentido, el regulador alertó que algunos atacantes aprovechan dinámicas del juego para ganar confianza o influir en los jóvenes de forma gradual.

Presión legal y antecedentes recientes

Las empresas tienen la obligación de responder a los pedidos del gobierno. Si no lo hacen, se exponen a sanciones económicas y posibles acciones judiciales. La iniciativa forma parte de un contexto global en el que crece la presión sobre las plataformas tecnológicas para que refuercen sus controles.

Uno de los casos más resonantes involucra a Roblox, que recientemente acordó pagar más de 23 millones de dólares en Estados Unidos tras denuncias por fallas en la protección de menores. Además, enfrenta más de 140 demandas judiciales que la acusan de haber facilitado situaciones de explotación infantil.

Los chats integrados en plataformas como Roblox son uno de los principales focos de preocupación por la seguridad infantil.

En paralelo, la compañía anunció cambios en su sistema: creará cuentas diferenciadas según la edad, con versiones específicas para niños pequeños y adolescentes, en un intento por restringir funciones y mejorar la seguridad.

Un desafío creciente para la industria

El avance de los videojuegos como espacios de interacción social plantea un nuevo reto para las autoridades. A diferencia de las redes tradicionales, los chats en tiempo real dentro de los juegos son más difíciles de monitorear automáticamente, lo que complica la detección de comportamientos peligrosos.

Australia busca ahora establecer un estándar más estricto, obligando a las plataformas a demostrar qué hacen concretamente para proteger a los usuarios más vulnerables en un entorno digital que sigue creciendo sin freno.